一文讀懂MCP協議:大模型AI-Agent的USB-C接口

在AI重構傳媒行業價值鏈的時代,內容生產、分發與用戶觸達的效能,正從單點效率升級為算法驅動的全局智能協同。然而,海量數據孤島、多平臺接口的煙囪式開發等瓶頸,仍在制約技術資源的AI化融合。

在AI重構傳媒行業價值鏈的時代,內容生產、分發與用戶觸達的效能,正從單點效率升級為算法驅動的全局智能協同。然而,海量數據孤島、多平臺接口的煙囪式開發等瓶頸,仍在制約技術資源的AI化融合。

本文深入拆解MCP協議,從技術架構到行業場景化實踐,為您揭示如何用"一次連接,全局調用"的下一代接口標準,釋放傳媒數據資產的真正潛能——讓技術資源不再成為創意與效率的枷鎖,而是驅動增長的新引擎。

【本文由@bexzhang主筆, @osli修訂, 來源:騰訊雲智慧傳媒 】

一、MCP起源

背景與痛點

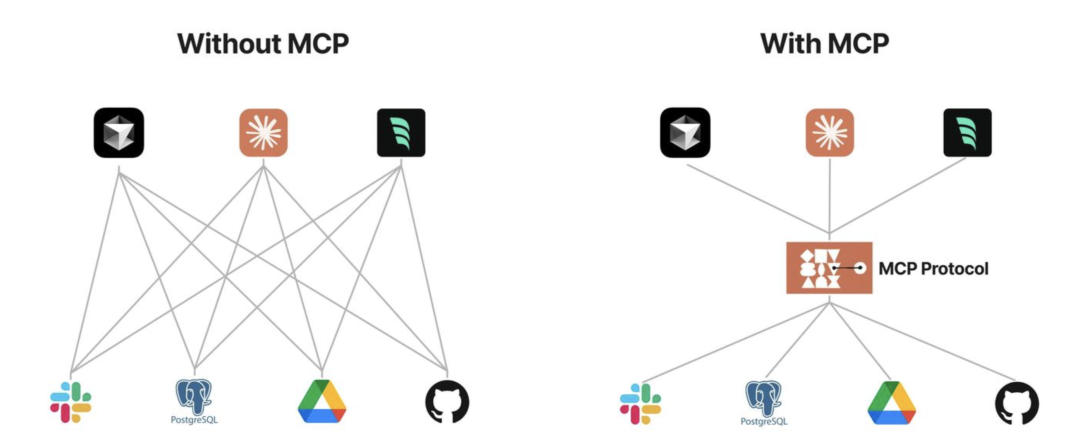

AI應用進入深水區後,模型與外部數據/工具的集成呈現"煙囪式開發"(每個模型需單獨對接不同數據源),導致開發成本高、安全性差、擴展困難。AI 模型和已有系統集成發展緩慢,一方面是企業級的數據很敏感,大多數企業都要很長的時間和流程來動;另一個方面是缺少一個開放的、通用的、有共識的協議標準。

市面上雖然有一些框架支持 Agent 開發,例如 LangChain Tools, LlamaIndex 或者是 Vercel AI SDK,需編寫大量定製代碼,難以規模化。

LangChain 和 LlamaIndex 整體發展混亂,代碼的抽象層次過高,在實際開發中,只要業務一旦開始複雜,糟糕的代碼設計帶來了非常糟糕的編程體驗。項目過於追求商業化了,忽略了整體生態的建設。

Vercel AI SDK 代碼抽象的比較好,但是也只是對於前端 UI 結合和部分 AI 功能的封裝還不錯,最大的問題是和 Nextjs 綁定太深了,對其它的框架和語言支持度不夠。

誕生與目標

提出者:Anthropic公司(Claude的開發者)於2024年11月底發佈並開源。https://www.anthropic.com/news/model-context-protocol

核心目標:建立類似USB-C的標準化協議,統一AI模型與外部資源的交互接口,實現"一次集成,處處運行"。解決當前 AI 模型因數據孤島限制而無法充分發揮潛力的難題,MCP 使得 AI 應用能夠安全地訪問和操作本地及遠程數據,為 AI 應用提供了連接萬物的接口。

技術演進時間線:

| 時間 | 階段 | 關鍵事件 |

|---|---|---|

| 2023年前 | 原始階段 | 每個AI需獨立開發Function Call接口 |

| 2023年 | 萌芽期 | LangChain等框架嘗試通用化工具調用 |

| 2024年11月 | 協議誕生 | Anthropic開源MCP 1.0版本 |

| 2025年Q1 | 生態爆發 | GitHub出現200+第三方MCP服務器實現 |

二、MCP的概念和優勢

MCP定義

MCP是一種開放協議,通過標準化語言和接口,實現AI模型與外部數據源/工具的無縫交互,核心功能包括:

- 統一翻譯器:將不同數據源的API轉換為模型可理解的標準化請求。

- 安全連接層:支持本地與遠程資源訪問,數據無需上傳至雲端。

這個協議的發佈最好機會應該是屬於 OpenAI 的,如果 OpenAI 剛發佈 GPT 時就推動協議,相信大家都不會拒絕,但是 OpenAI 變成了 CloseAI,只發布了一個封閉的 GPTs,這種需要主導和共識的標準協議一般很難社區自發形成,一般由行業巨頭來主導。

通俗類比概念

“萬能遙控器"比喻

想象每個企業系統都是不同品牌的智能家電(電視、空調、音響),原本每個設備都需要專屬遙控器(定製接口)。MCP就像一個預置了所有家電協議的萬能遙控器:AI助手拿著這個遙控器,既能讓"電視"播放監控視頻(調用安防系統),也能讓"空調"調節數據溫度(調整服務器負載),還能讓"音響"播報業務報告(觸發語音合成)——所有操作都通過統一按鍵(標準化指令)完成,無需再為每個設備尋找專用遙控器。

“AI的USB-C接口"比喻

官方將MCP比作AI領域的USB-C接口。類比來看,不同的AI助手就像不同的電子設備,以前每個設備需要不同的數據線連不同的外設(比如老式手機數據線各不相同),而MCP提供了一個統一的細窄接口,讓AI能夠即插即用各種外設。例如,通過MCP,一個AI助手今天可以連U盤(數據庫),明天插打印機(郵件系統),後天接顯示器(報告生成)——接口都一樣,只是功能不同。就像USB-C讓我們少了無數轉換頭和線纜,MCP也讓AI集成少了無數專有API和腳本。對於終端用戶來說,這意味著AI助手將變得更加多才多藝且使用方便,因為背後複雜的連接都被這個看不見的"USB-C"標準屏蔽掉了。

MCP的優勢

MCP(Model Context Protocol)是專為大語言模型(LLMs)應用設計的上下文協議,針對LLM應用中常見的數據孤島與工具集成痛點,MCP提供以下關鍵能力:

- 生態-MCP 提供很多現成的插件, AI 可以直接使用。

- 統一性-不限制於特定的 AI 模型,任何支持 MCP 的模型都可以靈活切換。

- 數據安全-可以自行設計接口確定傳輸哪些數據。

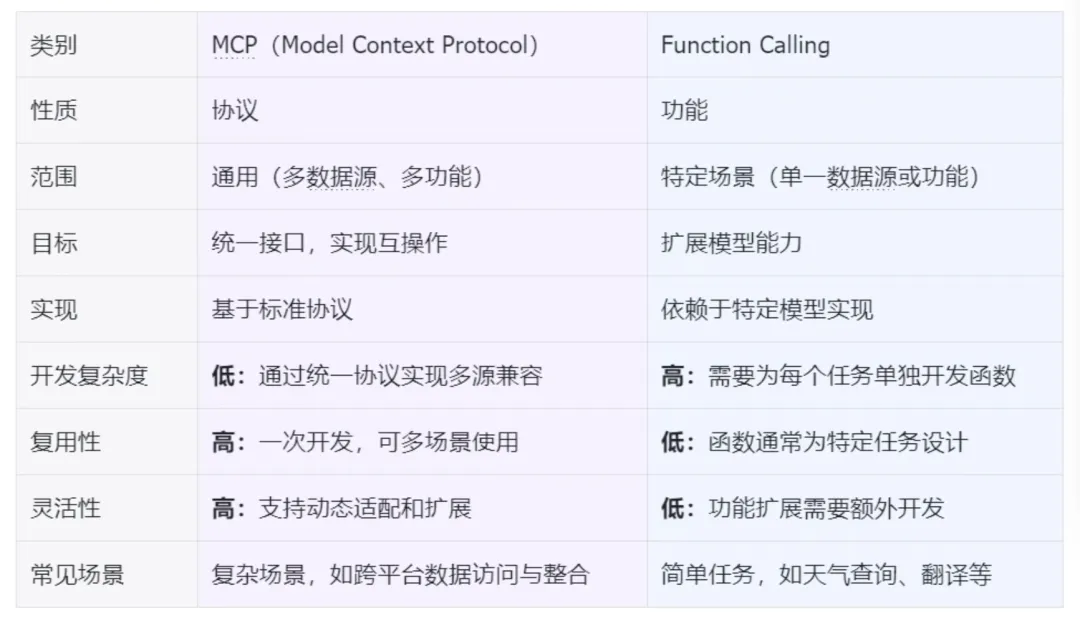

MCP 與 Function Calling 的區別

| MCP(Model Context Protocol),模型上下文協議 | Function Calling,函數調用 |

|---|---|

| 這兩種技術都旨在增強 AI 模型與外部數據的交互能力,但 MCP 不止可以增強 AI 模型,還可以是其他的應用系統。 | |

| MCP的"原語”(Prompts/Resources/Tools)設計支持更復雜的交互流程,而傳統Function Calling僅為單向請求。 | |

| MCP並非"不限制於特定AI模型”,而是需模型支持MCP協議。Function Callling同樣以來模型的特性支持。 |

三、MCP的核心原理和技術架構

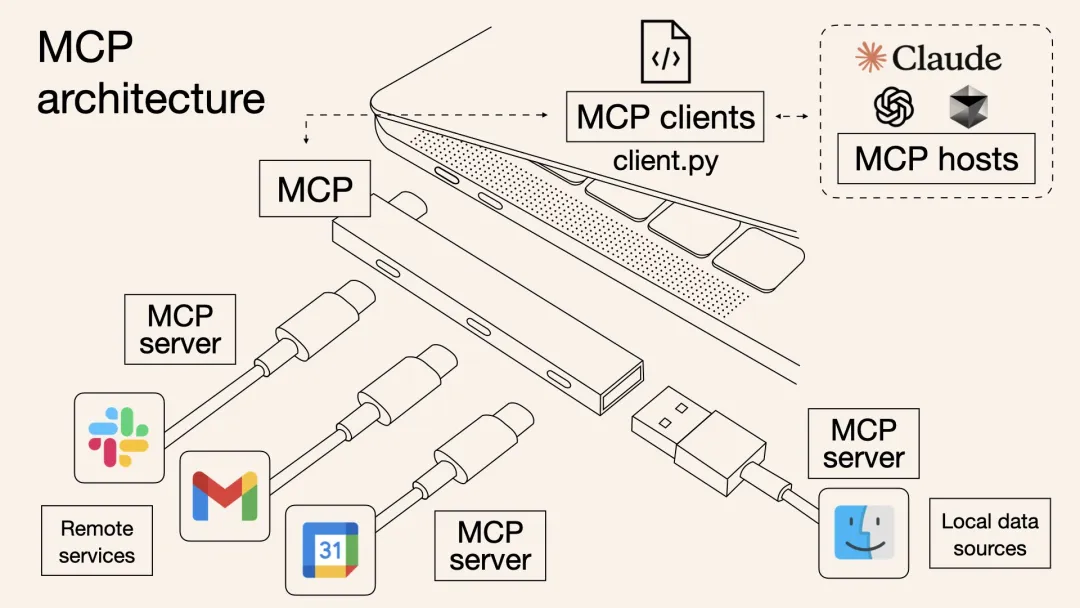

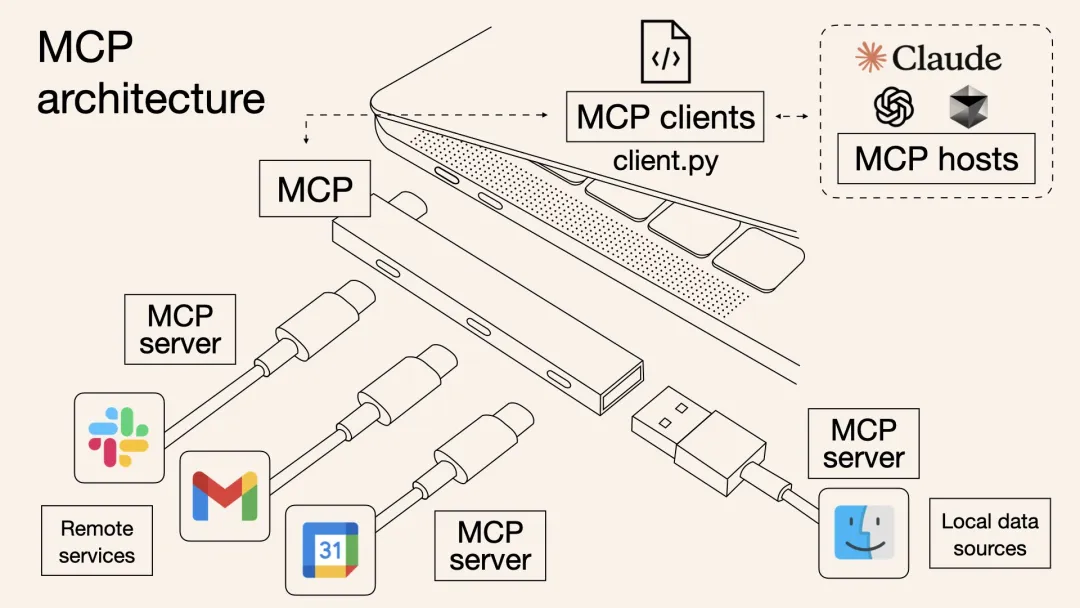

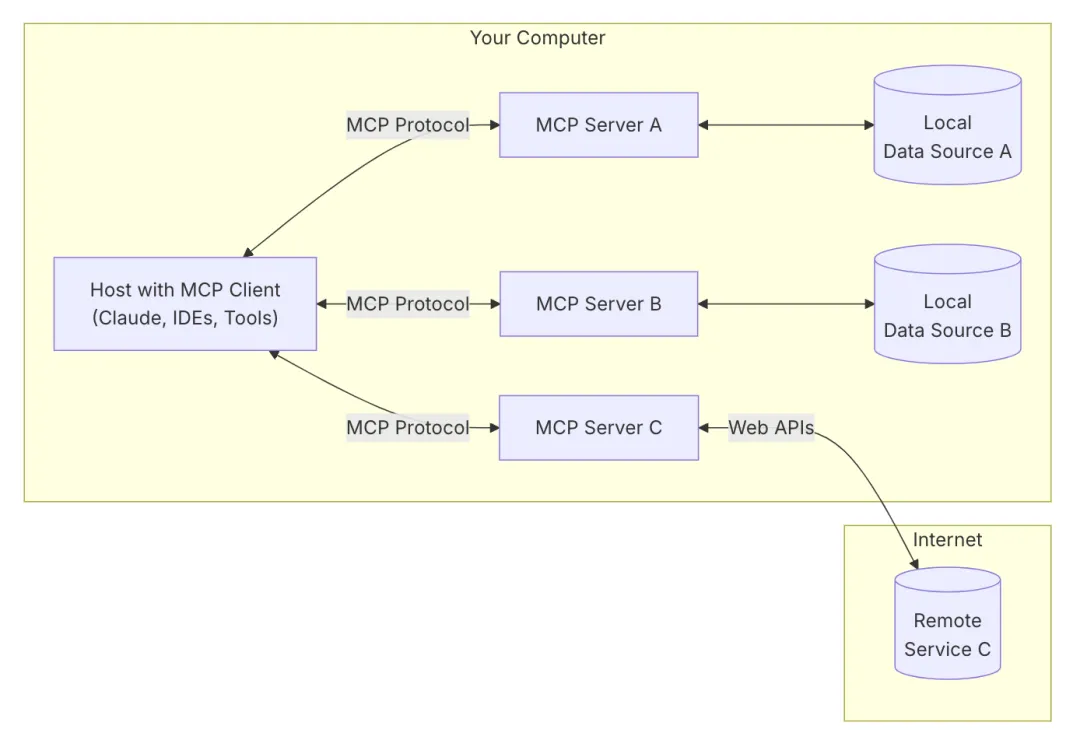

核心架構

MCP採用客戶端-服務器的分佈式架構,它將 LLM 與資源之間的通信劃分為三個主要部分:客戶端、服務器和資源。客戶端負責發送請求給 MCP 服務器,服務器則將這些請求轉發給相應的資源。這種分層的設計使得 MCP 協議能夠更好地控制訪問權限,確保只有經過授權的用戶才能訪問特定的資源。官方架構圖如下:

- MCP Host(主機應用):Hosts 是指 LLM 啟動連接的應用程序,像Cursor、Claude、Desktop、Cline 這樣的應用程序。

- MCP Client(客戶端):客戶端是用來在 Hosts 應用程序內維護與 Server 之間 1:1 連接。一個主機應用中可以運行多個MCP客戶端,從而同時連接多個不同的服務器。

- MCP Server(服務器):獨立運行的輕量程序,通過標準化的協議,為客戶端提供上下文、工具和提示,是MCP服務的核心。

- 本地數據源:本地的文件、數據庫和 API。

- 遠程服務:外部的文件、數據庫和 API。

這種架構下,AI主機通過MCP客戶端同時連接多個MCP服務器,每個服務器各司其職,提供對一種數據源或應用的標準化接入。這樣設計有幾個好處:一是模塊化,增加或移除某個數據源只需啟用或停用對應的服務器,不影響AI主體或其他部分;二是解耦,AI模型與具體數據源實現隔離開,通過協議交互,不直接依賴數據源的內部細節;三是雙向通信,不僅AI可以請求數據源,某些情況下數據源也能要求AI執行操作或生成內容,從而支持更復雜的交互流程。

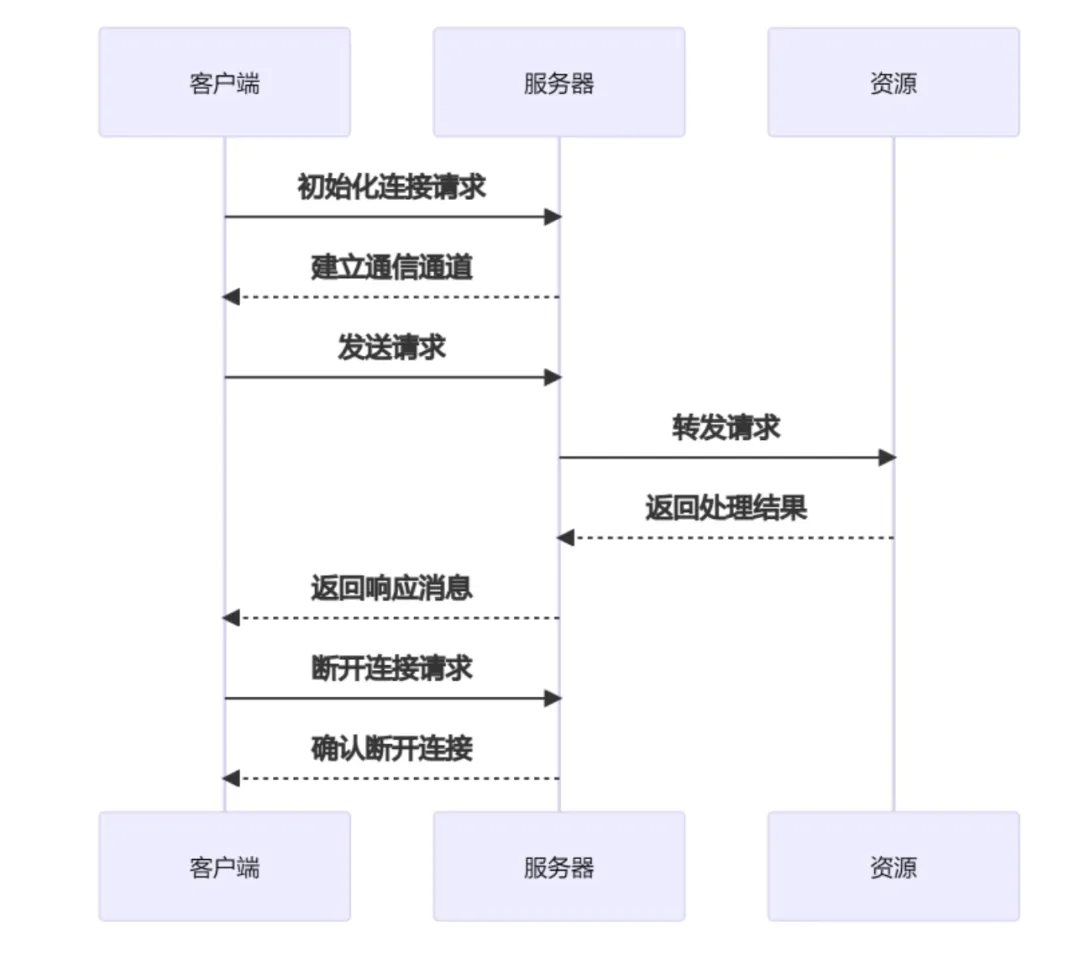

工作流程

- 初始化連接:客戶端向服務器發送連接請求,建立通信通道。

- 發送請求:客戶端根據需求構建請求消息,併發送給服務器。

- 處理請求:服務器接收到請求後,解析請求內容,執行相應的操作(如查詢數據庫、讀取文件等)。

- 返回結果:服務器將處理結果封裝成響應消息,發送回客戶端。

- 斷開連接:任務完成後,客戶端可以主動關閉連接或等待服務器超時關閉。

通信方式

MCP定義了一套基於JSON-RPC 2.0的消息通信協議。核心特點如下:

- 傳輸靈活:原生支持兩種傳輸方式——進程管道的STDIO(本地場景)和SSE+HTTP POST(網絡通信),同時允許開發者自定義其他傳輸通道。

- 消息透明:採用純JSON格式封裝三種消息類型——請求(帶唯一ID)、響應(含結果/錯誤)和通知(無回覆)。每條消息包含方法名和參數,類似函數調用,直觀表達"執行操作/獲取數據"等行為。

- 開發友好:相比二進制協議(如gRPC),JSON消息可人工閱讀,配合結構化日誌更易調試。協議層自動處理請求響應匹配、錯誤傳遞和併發管理,開發者只需關注業務邏輯。

關鍵機制 – “Primitives”(原語)概念:MCP將AI與外部系統交互的內容抽象為幾類原語,以此規範客戶端和服務器各自能提供的功能。

MCP服務器可以提供三種原語:

- Prompts(提示):預先編寫的提示詞或模板,相當於一段指導性文字片段,可以插入到模型的輸入中去影響其行為。例如服務器可以提供一個"代碼審查提示模板",供模型在閱讀代碼時使用。

- Resources(資源):結構化的數據或文檔內容,可供客戶端讀取並提供給模型作為上下文。例如從數據庫查詢到的一條記錄、用戶的筆記文檔內容等,都是資源類型。資源類似於"只讀文件",模型可以請求某個資源,服務器會返回相應的數據內容。

- Tools(工具):可以被模型調用的可執行操作或函數。這是MCP最強大也最具互動性的部分,模型可以要求服務器執行某個工具函數來獲取信息或改變外部狀態,比如調用"發送郵件"工具發送一封郵件,調用"查詢天氣"工具獲取天氣數據等。由於工具調用可能帶來副作用和安全風險,MCP規定模型調用工具必須經由用戶批准後才執行。換言之,工具就像模型可用的"按鍵",但每次按鍵需要真人確認,避免模型濫用外部操作權限。

MCP客戶端提供兩種原語能力用於輔助服務器完成複雜任務:

- Roots(根):這是一種由客戶端提供的文件系統入口或句柄。服務器可以通過Root來訪問客戶端這側的本地文件或目錄內容。例如客戶端可以授權服務器讀取某個文件夾(作為Root),那麼服務器就能代表模型瀏覽那個文件夾下的文件內容(通常仍以資源形式提供給模型)。Roots機制確保服務器只能訪問經授權的本地數據範圍,增強安全性。

- Sampling(採樣):這一機制允許服務器向客戶端發起請求,要求客戶端這側的LLM模型生成一段文本(即一次補全/推理)。簡單說,服務器也可以"反過來"調用模型,讓模型基於一些額外提示執行推理。Sampling可以用於構建多輪交互的智能Agent:服務器在執行某工具過程中,發現需要模型進一步推理決定下一步時,就可以用Sampling請求模型產出結果,再繼續後續操作。不過Anthropic也強調應謹慎使用這一機制,始終保持人類在環監督,以避免AI代理失控循環調用模型。Sampling機制並非所有MCP服務器均支持,需依賴客戶端實現。

通過上述原語分類,MCP清晰地定義了模型與外部交互的意圖類型。例如,讓模型獲取一段參考資料應該作為Resource提供,而不是混同於調用Tool;又如要求模型執行某操作就用Tool明確表示。這樣的設計使AI系統的上下文管理更結構化:模型知道某段信息是隻讀資料還是可執行操作,用戶也能對不同類型請求進行針對性地審批或監控。這比起簡單地給模型一個隱式"工具插件"要透明得多。Anthropic的開發者指出,他們最初也考慮過是否把所有交互都當作"工具調用"統一處理,但最終認為Prompt和Resource這兩類原語有其獨特意義,能表達不同用途的功能,因此保留了多元的原語概念。

四、MCP Server分類及應用

MCP Server是MCP服務的核心,主要從官方、第三方以及社區MCP Server三個角度對關注度較高的應用進行細分。

1.官方MCP Server

(由 Model Context Protocol 核心團隊維護,具備標準化協議實現和最佳實踐)

核心基礎設施

- modelcontextprotocol/server-filesystem(文件系統):提供標準化文件訪問接口,支持細粒度權限控制,基礎能力標杆實現。https://github.com/modelcontextprotocol/servers/tree/main/src/filesystem

拓展工具

- modelcontextprotocol/Google Drive(雲端文件):與 Google Drive 集成,允許列出、讀取和搜索文件。https://github.com/modelcontextprotocol/servers/tree/main/src/gdrive

AI增強工具

- modelcontextprotocol/aws-kb-retrieval-server(向量數據庫):官方向量檢索方案,支持高維數據存儲與相似性搜索。https://github.com/modelcontextprotocol/servers/tree/main/src/aws-kb-retrieval-server

2.第三方MCP Server

(由專業廠商/團隊維護,具備行業領域深度集成能力)

數據庫服務

- Tinybird MCP Server(實時數據分析):針對時序數據優化,提供低延遲 SQL 查詢接口。https://github.com/tinybirdco/mcp-tinybir

雲服務

- Qdrant MCP Server(向量搜索雲服務):企業級向量檢索雲服務,支持混合搜索和分佈式部署。https://github.com/qdrant/mcp-server-qdrant/

AI服務

- LlamaCloud Server(大模型託管平臺):提供多模態模型調用接口,支持模型微調和推理監控。https://github.com/run-llama/mcp-server-llamacloud

開發工具服務

- Neo4j(圖數據庫):圖數據庫服務,支持Cypher查詢與知識圖譜構建。https://github.com/neo4j-contrib/mcp-neo4j/

拓展工具服務

- Firecrawl (網頁爬取):支持抓取、爬取、搜索、提取、深入研究和批量抓取。https://github.com/mendableai/firecrawl-mcp-server?tab=readme-ov-file#firecrawl-mcp-server

3.社區MCP Server

(由開發者社區貢獻,覆蓋長尾需求和實驗性場景)

本地工具集成

- punkpeye/mcp-obsidian(知識管理工具):支持雙向同步 Obsidian 筆記庫,Markdown 內容解析優化。https://github.com/punkpeye/mcp-obsidian

自動化工具

- appcypher/mcp-playwright(瀏覽器自動化):基於 Playwright 的網頁操作自動化,支持動態 JS 執行。https://github.com/appcypher/awesome-mcp-servers#browser-automation

垂直領域工具

- r-huijts/mcp-aoai-web(藝術數據訪問):可通過自然語言交互訪問荷蘭國立博物館的藏品,提供藝術品元數據檢索。https://github.com/r-huijts/rijksmuseum-mcp

開發者工具

- sammcj/mcp-package-version(開發依賴管理):實時查詢 npm/pypi 包版本,防止幻覺版本建議。https://github.com/sammcj/mcp-package-version

隱私增強工具

- hannesrudolph/mcp-ragdocs(本地文檔檢索):基於本地向量庫的隱私安全文檔檢索方案。https://github.com/hannesrudolph/mcp-ragdocs

4.分類對比

| 維度 | 官方 Servers | 第三方 Servers | 社區 Servers |

|---|---|---|---|

| 維護週期 | 長期維護,版本迭代規律 | 依賴廠商支持週期 | 依賴個人開發者活躍度 |

| 協議兼容性 | 100% 符合最新 MCP 規範 | 通常支持核心規範 | 可能存在實驗性擴展 |

| 安全審計 | 經過官方安全認證 | 部分廠商提供商業級審計 | 無強制審計機制 |

| 部署複雜度 | 提供標準化安裝包和文檔 | 需要配置廠商專用憑證 | 常需手動調試依賴項 |

| 典型場景 | 基礎能力/關鍵業務場景 | 行業垂直領域深度需求 | 個性化/實驗性需求 |

補充說明:遠程 MCP 連接的支持

官方文檔中關於傳輸方式的描述可能會讓部分開發者誤解,認為 Remote MCP Connections(遠程 MCP 連接)已經實現。實際上,當前的客戶端和服務端都是在本地運行的。(當前如果需要連接遠程服務器,需要在客戶端-服務端連接後,由本地服務端再次向遠程服務器發起連接)

這一點在官方的 2025 年路線圖中有所提及https://modelcontextprotocol.io/development/roadmap :

實現 Remote MCP Connections是當前MCP項目組的最高優先級,允許客戶端通過互聯網安全地連接到 MCP 服務端。關鍵舉措包括:

- 認證與授權 (Authentication & Authorization):增加標準化的認證能力,特別是專注於 OAuth 2.0 支持。

- 服務發現 (Service Discovery):定義客戶端如何發現並連接到遠程 MCP 服務器。

- 無狀態操作 (Stateless Operations):探討 MCP 是否可以支持無服務器環境(serverless environments),在這種環境中,操作需要儘可能無狀態。

參考文章:

[1]https://www.anthropic.com/news/model-context-protocol

[2]https://modelcontextprotocol.io/development/roadmap

[3]https://github.com/modelcontextprotocol

[4]https://mcp.so/servers

[5]https://github.com/punkpeye/awesome-mcp-servers

[6]https://github.com/appcypher/awesome-mcp-servers

[7]https://github.com/modelcontextprotocol/python-sdk

[8]https://github.com/punkpeye/awesome-mcp-servers?tab=readme-ov-file#frameworks

[9]https://mp.weixin.qq.com/s/Toj2TudFNXx6_Z11zSRb2g